DataWhaleX魔搭_AI夏令营_四期AIGC方向_task03 学习笔记

任务详情

进阶上分-实战优化:我们今天的任务是了解微调的基本原理,对微调的各种参数有一个更加清楚的了解,来实现一个更好的效果,以及文生图的工作流平台工具ComfyUI,实现一个更加高度定制的文生图。

ComfyUI

简介

ComfyUI 是GUI的一种,是基于节点工作的用户界面,主要用于操作图像的生成技术,ComfyUI 的特别之处在于它采用了一种模块化的设计,把图像生成的过程分解成了许多小的步骤,每个步骤都是一个节点。这些节点可以连接起来形成一个工作流程,这样用户就可以根据需要定制自己的图像生成过程。

ComfyUI : The most powerful and modular stable diffusion GUI and backend.

找到的一些学习资料

ComfyUI的优势

ComfyUI的优势

- 模块化和灵活性:ComfyUI 提供了一个模块化的系统,用户可以通过拖放不同的模块来构建复杂的工作流程。这种灵活性允许用户根据自己的需求自由组合和调整模型、输入、输出、和其他处理步骤。

- 可视化界面:ComfyUI 提供了直观的图形界面,使得用户能够更清晰地理解和操作复杂的 AI 模型和数据流。这对没有编程背景的用户特别有帮助,使他们能够轻松构建和管理工作流程。

- 多模型支持:ComfyUI 支持多个不同的生成模型,用户可以在同一平台上集成和切换使用不同的模型,从而实现更广泛的应用场景。

- 调试和优化:通过其可视化界面,ComfyUI 使得调试生成过程变得更简单。用户可以轻松地追踪数据流,识别并解决问题,从而优化生成结果。

- 开放和可扩展:ComfyUI 是一个开源项目,具有高度的可扩展性。开发者可以根据需要编写新的模块或插件,扩展系统功能,并根据项目需求进行定制。

- 用户友好性:尽管其功能强大,但 ComfyUI 仍然保持了用户友好性,即使对于复杂任务,也能以相对简单的方式完成,使其成为生成式 AI 工作流程管理的有力工具。

使用魔搭社区提供的Notebook和免费的GPU算力体验来体验ComfyUI

Notebook

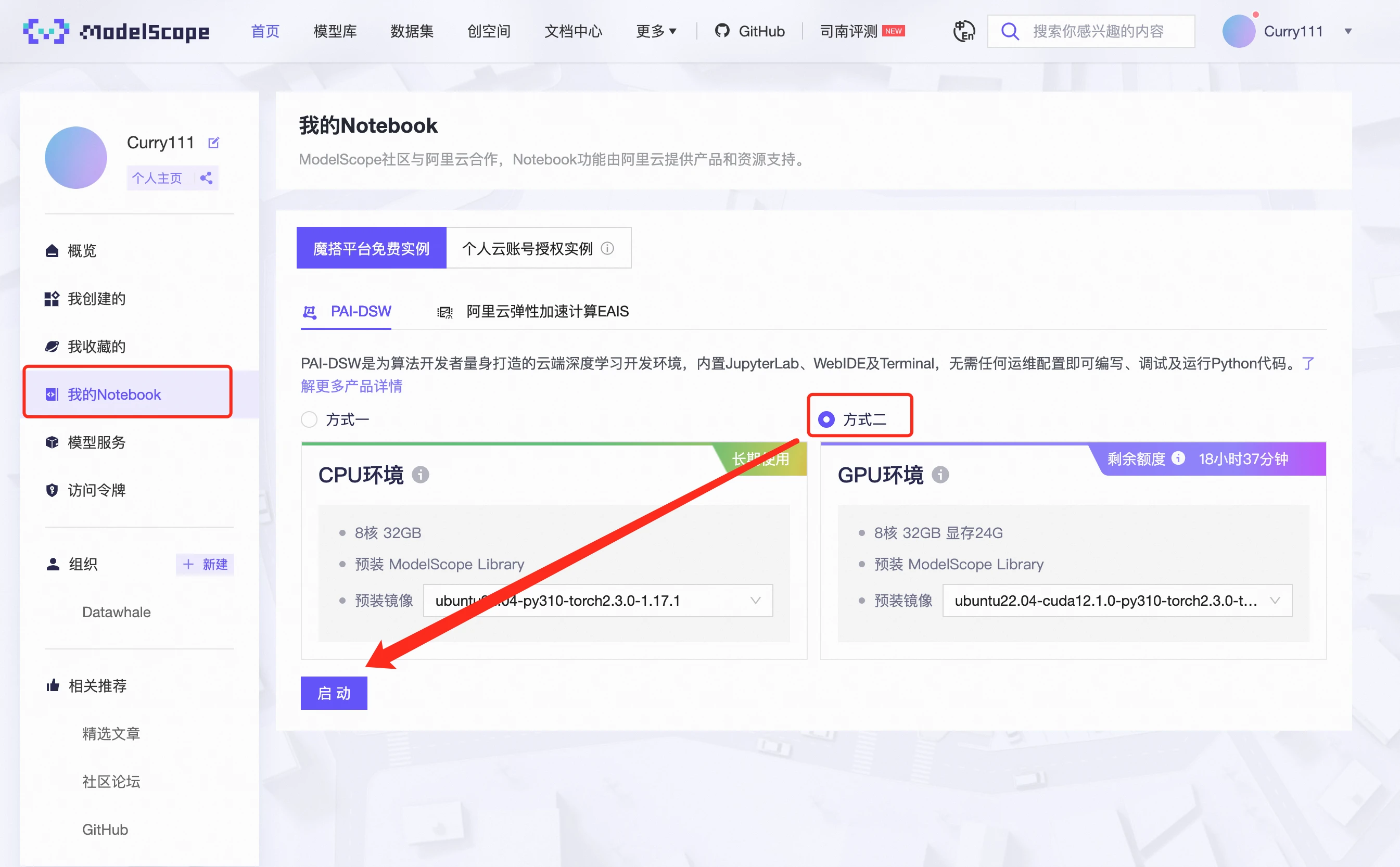

依然在魔搭社区打开GPU环境Notebook。

下载脚本代码文件

新建一个terminal,下载安装ComfyUI的执行文件和task1中微调完成Lora文件。

git lfs install

git clone https://www.modelscope.cn/datasets/maochase/kolors_test_comfyui.git

mv kolors_test_comfyui/* ./

rm -rf kolors_test_comfyui/

mkdir -p /mnt/workspace/models/lightning_logs/version_0/checkpoints/

mv epoch=0-step=500.ckpt /mnt/workspace/models/lightning_logs/version_0/ checkpoints/

进入ComfyUI的安装部署文件

双击进入ComfyUI.ipynb文件。一键执行安装程序。(点击Restart按钮)

进入预览界面

当执行到最后一个节点的内容输出了一个访问的链接的时候,复制链接到浏览器中访问。

不需要等待全部代码运行完毕,只需要等到链接出现即可打开它。

如果链接访问白屏,或者报错,就等一会再访问重试,程序可能没有正常启动完毕。

下载工作流脚本

本次Task用到两个工作流脚本,在下方的夸克网盘中。

首先下载kolors_example.json文件。点击ComfyUI主界面上的”Load”按钮,选择刚刚下载的文件,输入你的正向提示词、反向提示词后,点击Queue Prompt按钮运行。

以上的文件是不带Lora的工作流样例。接下来我们使用带Lora的工作流样例来生成图片。

- 这里的Lora是我们Task1微调训练出来的文件

- 地址是:/mnt/workspace/models/lightning_logs/version_0/checkpoints/epoch=0-step=500.ckpt

- 如有有其他的Lora文件,可以在下面截图Lora文件地址区域更换成自己的地址

同样地,先Load,再写提示词,最后生成图片。

一些学习网站

| 名称 | 链接地址 |

|---|---|

| 在魔搭使用ComfyUI,玩转AIGC! | https://modelscope.cn/headlines/article/429 |

| ComfyUI的官方地址 | https://github.com/comfyanonymous/ComfyUI |

| ComfyUI官方示范 | https://comfyanonymous.github.io/ComfyUI_examples/ |

| 别人的基础工作流示范 | https://github.com/cubiq/ComfyUI_Workflows |

| https://github.com/wyrde/wyrde-comfyui-workflows | |

| 工作流分享网站 | https://comfyworkflows.com/ |

| 推荐一个比较好的comfyui的github仓库网站 | https://github.com/ZHO-ZHO-ZHO/ComfyUI-Workflows-ZHO?tab=readme-ov-file |

魔搭官方教程:

Lora微调

Lora简介

LoRA (Low-Rank Adaptation) 微调是一种用于在预训练模型上进行高效微调的技术。它可以通过高效且灵活的方式实现模型的个性化调整,使其能够适应特定的任务或领域,同时保持良好的泛化能力和较低的资源消耗。这对于推动大规模预训练模型的实际应用至关重要。

Lora微调的原理

LoRA通过在预训练模型的关键层中添加低秩矩阵来实现。这些低秩矩阵通常被设计成具有较低维度的参数空间,这样它们就可以在不改变模型整体结构的情况下进行微调。在训练过程中,只有这些新增的低秩矩阵被更新,而原始模型的大部分权重保持不变。

Lora微调的优势

- 快速适应新任务

在特定领域有少量标注数据的情况下,也可以有效地对模型进行个性化调整,可以迅速适应新的领域或特定任务。 - 保持泛化能力

LoRA通过微调模型的一部分,有助于保持模型在未见过的数据上的泛化能力,同时还能学习到特定任务的知识。 - 资源效率

LoRA旨在通过仅微调模型的部分权重,而不是整个模型,从而减少所需的计算资源和存储空间。

详解

Task2中的的微调代码

import os

cmd = “””

python DiffSynth-Studio/examples/train/kolors/train_kolors_lora.py \ # 选择使用可图的Lora训练脚本DiffSynth-Studio/examples/train/kolors/train_kolors_lora.py

–pretrained_unet_path models/kolors/Kolors/unet/diffusion_pytorch_model.safetensors \ # 选择unet模型

–pretrained_text_encoder_path models/kolors/Kolors/text_encoder \ # 选择text_encoder

–pretrained_fp16_vae_path models/sdxl-vae-fp16-fix/diffusion_pytorch_model.safetensors \ # 选择vae模型

–lora_rank 16 \ # lora_rank 16 表示在权衡模型表达能力和训练效率时,选择了使用 16 作为秩,适合在不显著降低模型性能的前提下,通过 LoRA 减少计算和内存的需求

–lora_alpha 4.0 \ # 设置 LoRA 的 alpha 值,影响调整的强度

–dataset_path data/lora_dataset_processed \ # 指定数据集路径,用于训练模型

–output_path ./models \ # 指定输出路径,用于保存模型

–max_epochs 1 \ # 设置最大训练轮数为 1

–center_crop \ # 启用中心裁剪,这通常用于图像预处理

–use_gradient_checkpointing \ # 启用梯度检查点技术,以节省内存

–precision “16-mixed” # 指定训练时的精度为混合 16 位精度(half precision),这可以加速训练并减少显存使用

“””.strip()

os.system(cmd) # 执行可图Lora训练

| 参数名称 | 参数值 | 说明 |

|---|---|---|

| pretrained_unet_path | models/kolors/Kolors/unet/diffusion_pytorch_model.safetensors | 指定预训练UNet模型的路径 |

| pretrained_text_encoder_path | models/kolors/Kolors/text_encoder | 指定预训练文本编码器的路径 |

| pretrained_fp16_vae_path | models/sdxl-vae-fp16-fix/diffusion_pytorch_model.safetensors | 指定预训练VAE模型的路径 |

| lora_rank | 16 | 设置LoRA的秩(rank),影响模型的复杂度和性能 |

| lora_alpha | 4 | 设置LoRA的alpha值,控制微调的强度 |

| dataset_path | data/lora_dataset_processed | 指定用于训练的数据集路径 |

| output_path | ./models | 指定训练完成后保存模型的路径 |

| max_epochs | 1 | 设置最大训练轮数为1 |

| center_crop | 启用中心裁剪,用于图像预处理 | |

| use_gradient_checkpointing | 启用梯度检查点,节省显存 | |

| precision | “16-mixed” | 设置训练时的精度为混合16位精度(half precision) |

UNet、VAE和文本编码器的协作关系

UNet:负责根据输入的噪声和文本条件生成图像。在Stable Diffusion模型中,UNet接收由VAE编码器产生的噪声和文本编码器转换的文本向量作为输入,并预测去噪后的噪声,从而生成与文本描述相符的图像

VAE:生成模型,用于将输入数据映射到潜在空间,并从中采样以生成新图像。在Stable Diffusion中,VAE编码器首先生成带有噪声的潜在表示,这些表示随后与文本条件一起输入到UNet中

文本编码器:将文本输入转换为模型可以理解的向量表示。在Stable Diffusion模型中,文本编码器使用CLIP模型将文本提示转换为向量,这些向量与VAE生成的噪声一起输入到UNet中,指导图像的生成过程

高质量的数据集

当我们进行图片生成相关的工作时,选择合适的数据集是非常重要的。

推荐自学python爬取网站数据。爬虫教程推荐慕课上的。

爬虫对于想要用AI生成某动漫或漫画画风的作品的同学十分具有针对性。如,如果想生成一个长得像《瑞克与莫蒂》作品中姥爷的科学家,就需要用爬虫去爬取网页上的数据了。这是使用其他数据收集方式无法做到的。